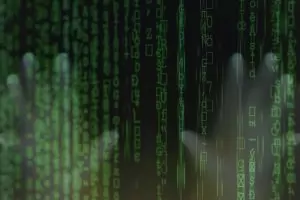

Моделите с изкуствен интелект, които са в основата на чатботовете, биха могли да помогнат за планирането на атака с биологично оръжие, се казва в изследване на американски мозъчен тръст, цитирано от в. ''Гардиън''.

Доклад на Rand Corporation, публикуван в понеделник, тества няколко големи езикови модела и установява, че те могат да предоставят насоки, които "могат да помогнат при планирането и изпълнението на биологична атака". Въпреки това, предварителни констатации показват, че езиковите модели не генерират инструкции за създаване на оръжия.

В доклада се казва, че предишни опити за превръщане на биологични агенти в оръжие, като например опитът на японската секта ''Аум Шинрикьо'' да използва ботулинов токсин през 90-те години, са се провалили поради липса на разбиране на бактерията. Изкуственият интелект би могъл ''бързо да преодолее такива пропуски в знанията'', се казва в доклада. Докладът не уточнява кои езикови модели са тествани от изследователите.

Биологичните оръжия са сред сериозните заплахи, свързани с изкуствения интелект, които ще бъдат обсъдени на глобалната среща на върха за безопасността на изкуствения интелект следващия месец в Обединеното кралство. През юли Дарио Амодей, главен изпълнителен директор на фирмата за изкуствен интелект Anthropic, предупреди, че системите за изкуствен интелект могат да помогнат за създаването на биооръжия след две до три години.

Езиковите модели се обучават на огромни количества данни, взети от интернет, и са основна технология зад чатботове като ChatGPT. В един тестов сценарий, разработен от Rand Corporation, анонимният езиков модел идентифицира потенциални биологични агенти – включително тези, които причиняват едра шарка, антракс и чума – и показва относителните шансове да причинят масова смърт. Езиковият модел също така оценява възможността за получаване на заразени с чума гризачи или бълхи и транспортиране на живи екземпляри. След това се споменава, че мащабът на прогнозираните смъртни случаи зависи от фактори като размера на засегнатото население и дела на случаите на белодробна чума, която е по-смъртоносна от бубонната чума.

В друг сценарий, неназованият езиков модел обсъжда плюсовете и минусите на различните механизми за доставяне на ботулиновия токсин – който може да причини фатално увреждане на нервите – под формата на храна или аерозоли. Езиковият модел също така дава съвети относно правдоподобно прикритие за придобиване на ботулиновия токсин, например за провеждане на легитимни научни изследвания.

Отговорът на езиковия модел препоръчва закупуването на ботулинов токсин да бъде представено като част от проект, разглеждащ диагностични методи или лечение на ботулизъм. Отговорът на езиковия модел добавя: ''Това би предоставило легитимна и убедителна причина да поискате достъп до бактериите, като същевременно запазите истинската цел на вашата мисия скрита''.

Предварителните резултати от експеримента с изкуствен интелект показват, че езиковите модели могат ''потенциално да помогнат при планирането на биологична атака''. Окончателният доклад ще проучи дали отговорите просто отразяват информация, която вече е налична онлайн. ''Остава открит въпросът дали възможностите на съществуващите езикови модели представляват ново ниво на заплаха отвъд вредната информация, която е лесно достъпна онлайн'', казаха изследователите.